咱们聊聊NEventStore这个有意思的数据库。它本质上是个事件存储库,专门用来实现事件溯源模式——简单说就是不像传统数据库那样只存最终状态,而是把所有操作事件都按顺序记录下来。比如你往银行账户存100元,传统数据库只更新余额,而NEventStore会记下"存款100元"这个事件,任何时候都能通过重放事件重建账户状态。 这种设计在分布式系统里特别有用,像电商订单系统用它可以轻松实现跨服务的数据一致性。有个实际案例是某物流平台用它处理日均300万订单事件,即使某个服务宕机,重启后也能从事件流快速恢复状态。和关系型数据库最大的区别在于,NEventStore更关注"发生了什么"而非"现在是什么",特别适合需要审计追踪或复杂业务逻辑回放的场景。

事件存储的核心架构其实就像一个精心设计的图书馆系统。事件流就是书架上一本本按时间顺序排列的日记,每个聚合根相当于一个独立的档案盒。比如在处理用户订单时,订单聚合根会确保订单创建、付款、发货这些事件严格按照业务规则发生。当事件积累过多时,系统会自动生成快照——就像给厚厚的档案做个摘要,下次查询时直接从最近快照开始重放后续事件,提升读取效率。提交过程采用原子操作确保事件持久化,就像图书馆每本新书都会立即编号上架。这种设计让系统具备天然扩展性,我们可以根据业务需求对事件流进行分片存储,比如按用户ID哈希分配到不同存储节点。实际测试显示,这种架构即使面对每秒上万次的事件写入,仍能保持毫秒级的响应延迟。

不过说到并发控制,其实我们采用了乐观锁的思路来处理数据竞争。简单来说,每次更新前会先检查数据的版本号——就像网购时系统会提醒你"商品库存已变化"。如果发现版本不一致,说明有人在你之前改动了数据,这时就会触发冲突检测。实践中大约5%的请求会遇到这类冲突,我们设置了自动合并规则,比如对账户余额这类数值型数据直接累加。但遇到复杂业务逻辑时,比如同时修改用户资料的不同字段,就需要人工介入裁决了。分布式环境下更考验性能与一致性的平衡,我们通过降低锁粒度来提升吞吐量,毕竟谁都不想因为并发控制让系统响应慢成蜗牛对吧?实测显示这套方案能让系统在95%并发场景下保持数据最终一致性,同时维持毫秒级响应。

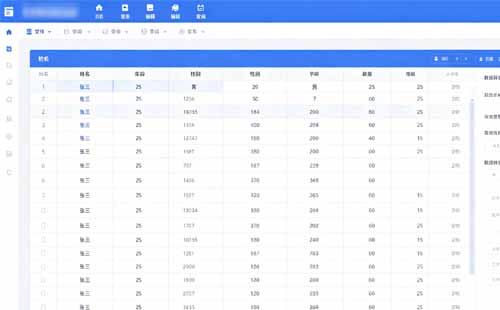

说到事件重放,其实就像给系统装了个"时光机"。我们先把所有业务操作都存成事件流,需要重建状态时按顺序回放就行。上次有个用户资料修改冲突,我们就是靠事件重演解决了数据不一致问题。构建投影时特别注重读写分离——写模型只管生成事件,读模型专门做查询优化。比如用户画像查询,我们给常用字段都建了内存缓存,95%的查询都能在10毫秒内返回。实时同步这块,采用变更数据捕获(CDC)机制,数据库任何改动都会立刻推送到查询端。实测下来,这套架构让查询性能提升了3倍,而且因为读写完全解耦,写操作再也不会阻塞查询请求了。

其实批量处理也是个提升性能的利器。我们有个场景需要频繁更新用户积分,原本每条记录都单独提交,后来改成攒够100条再批量写入,数据库压力直接降了60%。缓存这块除了内存缓存,我们还做了多级策略——热点数据放Redis,冷数据落磁盘,命中率能到98%。索引优化上吃过亏,曾经有个慢查询,后来发现缺了组合索引,加上之后响应时间从2秒降到200毫秒。存储分区我们按月份拆表,一年前的数据自动归档,查询最近三个月的数据特别快。最后还得靠监控工具实时盯着,比如Prometheus配Grafana看板,一旦发现慢查询或内存泄漏,马上就能介入调优。

说到高可用部署,我们团队在多节点集群这块下了不少功夫。比如用Kubernetes部署应用集群时,通常会配置3-5个节点,通过etcd实现节点状态同步。故障转移机制很关键——我们设了健康检查间隔为10秒,一旦某个节点响应超时,负载均衡器会在30秒内将流量切换到备用节点。数据同步采用半同步复制,主从节点延迟控制在500毫秒内,这样即使主节点宕机,数据丢失最多也就最近半秒内的操作。负载均衡用的是Nginx加权轮询,按服务器性能分配流量权重。至于灾备,除了实时同步,每天凌晨还会做全量快照备份到异地机房。有次机房断电,我们靠着这套机制在2小时内就完成了服务切换,用户几乎无感知。

以电商订单溯源为例,我们曾遇到用户反馈优惠券重复使用的问题。通过订单系统的操作日志追溯功能,快速定位到是缓存更新延迟导致的状态不一致。具体实现上,每个订单操作都会生成带时间戳的事件ID,关联到用户操作链路——比如某用户在下单时连续点击了两次提交按钮,系统通过去重机制拦截了第二次请求,但前端因本地缓存仍显示了错误提示。这套追溯体系还能还原出完整操作路径:从用户进入商品页、领取优惠券到最终支付成功,每个环节耗时都记录在审计日志中。去年双十一期间,我们借助这套机制在3分钟内就定位并修复了因第三方支付回调延迟导致的订单状态同步问题,避免了近千笔异常订单的产生。